Um grupo de cientistas de inteligência artificial está pedindo que as nações criem um sistema de supervisão global para evitar potenciais resultados catastróficos se os humanos perderem o controle da IA.

Em uma declaração, um grupo de cientistas influentes de IA levantou preocupações de que a tecnologia que eles ajudaram a desenvolver poderia causar sérios danos se o controle humano fosse perdido.

“A perda do controle humano ou o uso malicioso desses sistemas de IA pode levar a resultados catastróficos para toda a humanidade. Infelizmente, ainda não desenvolvemos a ciência necessária para controlar e salvaguardar o uso de tal inteligência avançada.”

Os cientistas concordaram que as nações precisam desenvolver autoridades para detectar e responder a incidentes de IA e riscos catastróficos dentro de suas jurisdições e que um plano de contingência global precisa ser desenvolvido.

“A longo prazo, os estados devem desenvolver um regime de governança internacional para evitar o desenvolvimento de modelos que possam representar riscos catastróficos globais.”

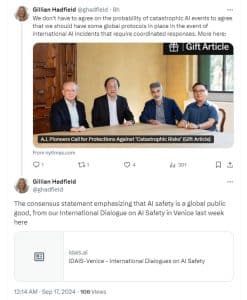

A declaração se baseia em descobertas do Diálogo Internacional sobre Segurança de IA em Veneza no início de setembro, o terceiro encontro desse tipo organizado pelo grupo de pesquisa sem fins lucrativos dos EUA, Safe AI Forum.

A professora Gillian Hadfield, da Universidade Johns Hopkins, compartilhou a declaração em uma postagem e disse:

“Se tivéssemos algum tipo de catástrofe daqui a seis meses, se detectarmos que há modelos que estão começando a se autoaprimorar autonomamente, para quem você vai ligar?”

Eles declararam que a segurança da IA é reconhecida como um bem público global, exigindo cooperação e governança internacionais.

Os desenvolvedores de IA propuseram 3 processos principais: acordos e instituições de preparação para emergências, uma estrutura de garantia de segurança e pesquisa independente global de segurança e verificação de IA.

A declaração teve mais de 30 signatários dos Estados Unidos, Canadá, China, Grã-Bretanha, Cingapura e outros países. O grupo era composto por especialistas de importantes instituições e universidades de pesquisa em IA e vários vencedores do Prêmio Turing, o equivalente ao Prêmio Nobel de computação.

Os cientistas disseram que o diálogo era necessário devido à redução do intercâmbio científico entre superpotências e à crescente desconfiança entre os EUA e a China, aumentando a dificuldade de se chegar a um consenso sobre ameaças de IA.

No início de setembro, os EUA, a UE e o Reino Unido assinaram o primeiro tratado internacional de IA juridicamente vinculativo do mundo, priorizando os direitos humanos e a responsabilização na regulamentação de IA.

No entanto, corporações e executivos de tecnologia disseram que o excesso de regulamentação pode sufocar a inovação, especialmente na União Europeia.