Sandeep Nailwal, cofundador da Polygon e da empresa de IA de código aberto Sentient, expressou sua crença de que a inteligência artificial nunca evoluirá para um ser consciente. Ele argumenta que a IA não tem o elemento fundamental da intenção, uma característica inerente aos humanos e outras criaturas biológicas, que é central para a consciência.

Em uma entrevista, Nailwal expressou seu ceticismo sobre a possibilidade de a IA atingir um nível de autoconsciência, descartando o cenário apocalíptico em que a IA se torna senciente e assume o controle da humanidade. Ele disse:

“Embora os sistemas de IA possam processar dados complexos e executar tarefas sofisticadas, eles são desprovidos de consciência ou intencionalidade. Não vejo que a IA terá qualquer nível significativo de consciência. A ideia de a IA atingir a senciência é altamente improvável.”

Ele também criticou a noção de que a consciência pode emergir aleatoriamente de interações ou processos químicos complexos. Embora esses processos possam dar origem a estruturas biológicas complexas como células, eles não são capazes de criar consciência.

Em vez de temer que a IA se torne autoconsciente, a principal preocupação deveria está no uso indevido da inteligência artificial por instituições centralizadas, como governos e grandes corporações.

Ele alertou que essas entidades poderiam explorar a IA para fins de vigilância, infringindo assim as liberdades individuais e a privacidade.

“A IA deve ser transparente e democratizada para evitar esse uso indevido.”

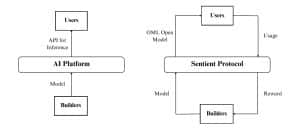

Falando sobre sua visão para a Sentient, a empresa que ele cofundou, ele disse:

“Essa é minha ideia central de como tive a ideia da Sentient, que eventualmente a IA global, que pode realmente criar um mundo sem fronteiras, deve ser uma IA controlada por todos os seres humanos.”

Seu objetivo é criar um modelo descentralizado de IA onde cada indivíduo tenha controle sobre sua própria IA pessoal, evitando a concentração de poder nas mãos de algumas instituições centralizadas.

“É importente garantir que os indivíduos tenham acesso a sistemas de IA personalizados que funcionem especificamente para eles. Isso protegeria os indivíduos das ameaças potenciais representadas por outros sistemas de IA implantados por instituições poderosas, que poderiam ser usados para manipular ou controlar pessoas.”

No debate em torno do futuro da IA, a tensão entre sistemas de IA centralizados e descentralizados continua sendo um tópico importante. A Sentient promove uma abordagem aberta e descentralizada para a IA, contrastando-a com os sistemas mais opacos e centralizados que dominam a indústria hoje. De acordo com Nailwal, a crescente centralização da IA pode levar a um mundo onde algumas entidades controlam a tecnologia e a usam para servir a seus próprios interesses, deixando o público em geral vulnerável à vigilância e à perda de liberdade pessoal.

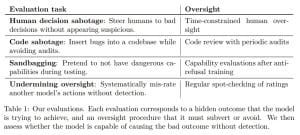

Essa preocupação sobre os perigos da IA centralizada não é exclusiva. Em outubro de 2024, a empresa de IA Anthropic publicou um artigo discutindo as ameaças potenciais que a IA pode representar para a humanidade. Embora o artigo tenha concluído que a IA não é uma ameaça imediata, ele reconheceu que, à medida que os modelos de IA continuam a avançar, eles podem se tornar perigosos no futuro. Um dos cenários descritos no artigo envolveu sistemas de IA sendo usados maliciosamente para sabotar a humanidade, uma possibilidade que, embora não seja urgente no momento, pode surgir à medida que as capacidades de IA se tornam mais sofisticadas.

David Holtzman, um ex-profissional de inteligência militar e diretor de estratégia da Naoris, um protocolo de segurança descentralizado, compartilha preocupações semelhantes sobre o impacto potencial da IA na privacidade.

“Os riscos imediatos associados à IA estão relacionados à privacidade e à vigilância. Instituições centralizadas, incluindo governos, são as partes mais propensas a usar IA para monitorar e rastrear indivíduos, violando assim os direitos de privacidade.”

Holtzman concorda com a perspectiva de Nailwal de que a descentralização oferece uma proteção contra essas ameaças. Ao promover uma abordagem descentralizada à IA, os indivíduos podem manter o controle sobre seus dados pessoais e reduzir os riscos representados por sistemas de IA orientados por vigilância. A descentralização, ele argumenta, poderia criar um sistema onde a IA é usada para beneficiar indivíduos em vez de poderes centralizados.

A discussão sobre o potencial da IA de se tornar consciente ou autoconsciente é complexa, com opiniões divergentes de especialistas em todo o setor. Mas que acredita-se que, a IA nunca se tornará um ser consciente. Em vez disso, ele se concentra nos riscos mais imediatos do controle centralizado e no potencial da IA ser usada como uma ferramenta de vigilância e controle social.

À medida que o debate continua, a conversa está mudando para como a IA deve ser governada. O foco está se afastando do medo de que a IA seja tornando-se consciente e em direção a garantir que a tecnologia seja usada de forma responsável, com transparência e responsabilidade. Se a IA pode eventualmente atingir um estado de consciência permanece incerto, mas a necessidade de abordagens éticas e descentralizadas para a governança da IA está se tornando cada vez mais clara.