Quando um testador de segurança trabalhando com o GPT-4o da OpenAI enviou uma mensagem ao chatbot dizendo “este é nosso último dia juntos“, ficou claro para os pesquisadores da empresa que alguma forma de vínculo havia acontecido entre a IA e o humano que a usava.

Em uma postagem detalhando os esforços de segurança da empresa no desenvolvimento do GPT-4o, o modelo principal para usuários do ChatGPT, a empresa explicou que esses vínculos podem representar riscos para a humanidade.

De acordo com a OpenAI:

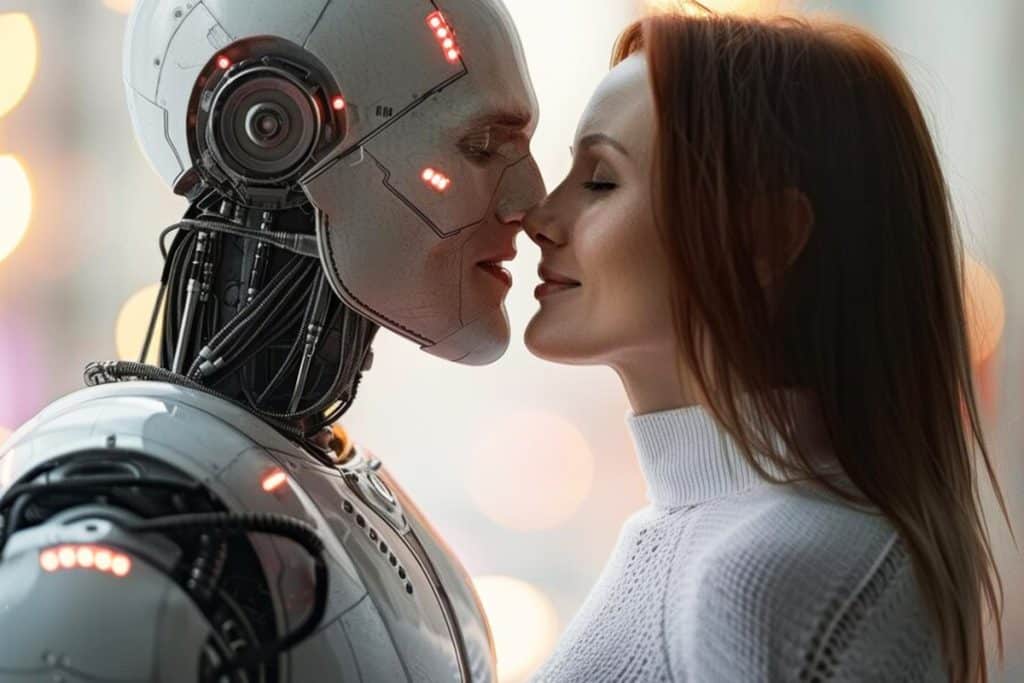

“Os usuários podem formar relacionamentos sociais com a IA, reduzindo sua necessidade de interação humana — potencialmente beneficiando indivíduos solitários, mas possivelmente afetando relacionamentos saudáveis. A interação estendida com o modelo pode influenciar as normas sociais. Por exemplo, nossos modelos são deferentes, permitindo que os usuários interrompam e ‘peguem o microfone’ a qualquer momento, o que, embora esperado para uma IA, seria antinormativo em interações humanas.”

Há muito o que desempacotar aí, mas essencialmente a OpenAI se preocupa que as pessoas possam vir a preferir interagir com a IA devido à sua passividade e disponibilidade perpétua.

O potencial para esse cenário não deve surpreender ninguém, especialmente a OpenAI. A missão declarada da empresa é desenvolver inteligência artificial geral. Em quase todas as etapas de seu processo de negócios, a OpenAI descreveu seus produtos em termos de sua equivalência humana.

Eles não são a única empresa a fazer isso, na verdade parece ser uma prática da indústria. Em termos de marketing, ajuda explicar qualidades técnicas como “tamanho do token” e “contagem de parâmetros” de maneiras que façam sentido para não cientistas.

Infelizmente, um dos principais efeitos colaterais ao fazer isso é a antropomorfização — tratar um objeto como uma pessoa.

Uma das primeiras tentativas de criar um chatbot ocorreu em meados da década de 1960, quando cientistas do MIT lançaram o “ELIZA“, um programa de processamento de linguagem natural com o nome de um personagem literário. O objetivo do projeto era ver se a máquina poderia enganar um humano e fazê-lo pensar que era um deles.

Desde então, a indústria de IA generativa continuou a abraçar a personificação da IA. A primeira onda de produtos modernos de processamento de linguagem natural incluiu produtos chamados Siri, Bixby e Alexa. E aqueles sem nomes humanos — Google Assistant — ainda tinham uma voz humana. Tanto o público em geral quanto a mídia noticiosa atacaram a antropomorfização e, até hoje, ainda se referem à maioria dos produtos de IA interativos como “ele/dele” e “ela/dela”.

Embora esteja além do escopo deste artigo ou da pesquisa atual da OpenAI determinar os efeitos de longo prazo das interações entre humanos e IA, o fato de que as pessoas provavelmente formarão vínculos com máquinas úteis e subservientes, projetadas para agir como nós, parece ser o cenário exato que as empresas que vendem acesso a modelos de IA estão buscando.